알리바바그룹홀딩스(Alibaba Group Holding)가 인간 감정을 읽어내는 능력을 갖춘 AI 모델인 R1-Omni를 공개했다. 움직임과 음성을 통해 감정을 분석하는 게 가능하다고 한다.

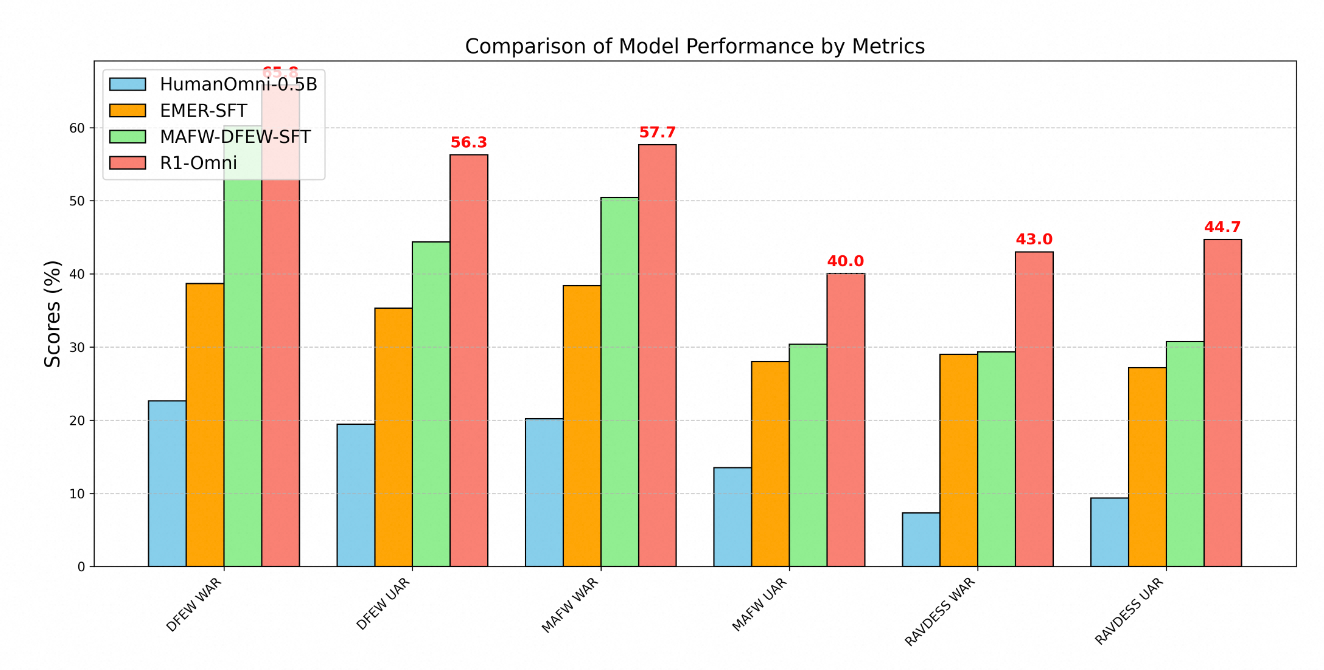

R1-Omni 기반이 된 모델은 알리바바 수석 연구원(Jiaxing Zhao)이 제작한 오픈소스 모델 HumanOmni-0.5B다. 알리바바 측은 HumanOmni-0.5B와 사전 훈련 모델인 EMER-SFT, 감정 분석 데이터세트를 학습한 MAFW-DFEW-SFT, 그리고 최종 모델인 R1-Omni를 모두 오픈소스로 공개했다.

알리바바 측은 AI가 답변을 생성하는 과정에서 사고 과정을 명확히 서술하도록 설계했다. 이를 통해 검증 가능한 보상 강화 학습(RLVR, Reinforcement Learning with Verifiable Rewards) 기법을 도입했다. 단순히 정답 여부를 확인하는 것보다 세부적인 조정을 가능하게 한다는 점에서 기존의 학습 방식과 차별화된다.

한편 R1-Omni 속 R1이 최근 발표된 DeepSeek-R1을 의식한 것인지 여부는 불분명하다. 하지만 R1-Omni는 DeepSeek-R1에서도 사용된 GPRO(Group Relative Policy Optimization) 기법을 적용해 학습 효율성을 높였다고 한다. 관련 내용은 이곳에서 확인할 수 있다.