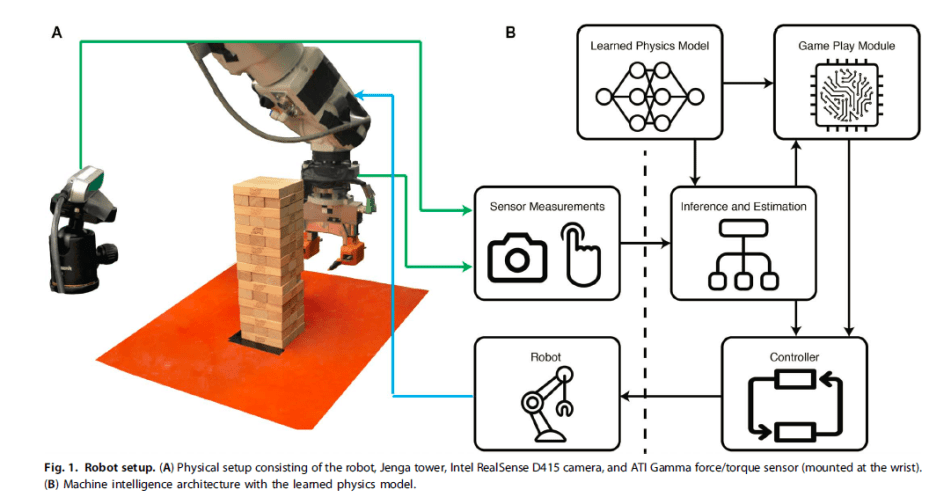

MIT 연구팀이 인간처럼 시각과 손끝의 물리적 촉각 피드백을 이용해 젠가를 배울 수 있도록 학습하는 로봇을 개발했다고 한다. 로봇 손가락은 블록 마찰과 운동 방법 등을 감지할 수 있다.

로봇에게 시각적 데이터를 중요하다. 젠가의 타워 모양과 위치 관계를 파악할 때 카메라가 중요한 역할을 하는 것. 하지만 이번 연구에서 가장 인상적인 건 이 로봇은 젠가 게임 방법이나 블록 움직임, 상호 작용이 아니라 로봇 자체가 촉각을 느낄 수 있다는 것이다. 이를 통해 상하좌우 블록 사이에 놀이가 있다는 걸 인식하고 균형을 유지할 수 있도록 위에 쌓게 스스로 노는 방법을 배운다. 100회 넘는 플레이를 통해 게임 방식을 학습한다.

이 연구를 진행하는 이유는 공장에서 사용하는 로봇은 지금은 특정 동작이나 행동만 수행하도록 프로그래밍되어 있다. 이런 로봇팔은 작업 효율화에는 기여를 하지만 한 가지 작업마다 로봇 1대를 배치해야 하는 등 비용 상승이 발생한다. 하지만 만일 1대만으로 멀티태스킹을 진행할 수 있다면 어떨까. 시각과 촉각 조합을 통해 주위 세계와 상호 작용을 하듯 로봇도 중력과 마찰 등 힘의 사용 방식을 습득할 수 있도록 해 로봇을 다용도로 활용할 수 있도록 하려는 취지로 연구를 진행하는 것이다. 관련 내용은 이곳에서 확인할 수 있다.