구글이 대화 특화형 AI인 람다(LaMDA)를 이용한 차세대 대화형 AI 서비스인 바드(Bard)를 2023년 2월 8일 발표했다. 하지만 바드를 소개하는 애니메이션 이미지에서 부정확한 대답을 하면서 2월 8일 미국 주식 시장에서 구글 모기업인 알파벳 주가는 전날보다 8% 하락해 시가총액으로 1,200억 달러가 넘는 손실이 발생했다고 한다.

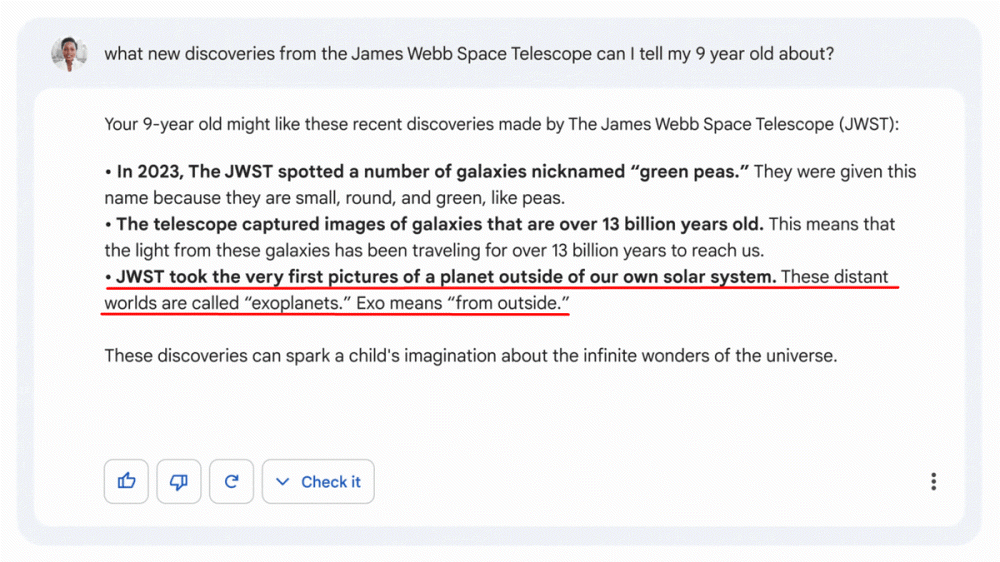

구글이 발표한 AI 검색 어시스턴트인 바드는 검색 결과 텍스트 요약을 생성할 수 있다. 하지만 바드가 어떻게 작동하는지 보여주는 데모에서 기능 정확성이 의문시되는 결과가 출력됐다. 문제가 된 애니메이션 이미지에선 사용자가 검색 상자에 “what new discoveries from the James Webb Space Telescope can I tell my 9 year old about?”라고 입력한다. 그러자 “Your 9-year old might like these recent discoveries made by The James Webb Space Telescope”라는 답하는 등 다양한 답변을 제시한다. 그 중에는 “JWST took the very first pictures of a planet outside of our own solar system. These distant worlds are called “exoplanets.” Exo means “from outside.”라는 말이 있는데 이런 먼 행성은 태양계 외 행성(exoplanets)으로 불리며 exo는 밖에서 왔다는 의미로 실제 태양계 행성 첫 사진은 2004년 칠레 초대형 망원경에 의해 촬영됐다.

이 지적에 따라 알파벳 주가는 전날 1주당 106달러에서 8% 하락해 98달러에 거래를 종료했다. 8% 하락으로 알파벳은 시가총액 1,200억 달러 이상을 잃었다고 한다. 겉보기에는 정확한 대화형 AI 서비스여야 하는 바드가 생성한 부정확한 답에 대해 우려가 제기되는 반면 바드 경쟁자인 챗GPT를 개발하는 오픈AI는 AI 기술 분야에는 한계가 있어 인간 질문에 대해 정확하지 않거나 무의미한 답을 생성할 수 있다고 인정하고 있다.

구글 측은 이번 바드의 반응으로 엄격한 테스트 과정의 중요성이 떠올렸다며 현실 세계 품질과 안전성, 근거에 대한 높은 기준을 충족하도록 개발해야 한다고 밝히고 있다. 관련 내용은 이곳에서 확인할 수 있다.

한편 스테이블 디퓨전과 미드저니 같은 이미지 생성 AI가 자동 생성한 이미지는 저작권 문제를 중심으로 많은 논의가 이뤄지고 있다. 구글 검색 공식 지원(Google Search Central) 측은 공식 블로그에서 AI가 생성한 콘텐츠는 검색 가이드라인을 위반하지 않는다고 밝혔다.

구글은 유용한 정보를 제공하는 능력을 변화시키는 AI 힘을 오랫동안 믿어왔다고 강조한 것. 실제로 구글은 자연 언어 처리 모델인 람다를 개발했으며 람다를 기반으로 한 대화형 AI인 바드를 구글 검색에 통합할 예정이다.

구글은 AI와 자동화에 대한 적절한 사용은 구글 가이드라인을 위반하지 않는다면서 어떻게 제작된 콘텐츠라도 전문성, 경험, 권위성, 신뢰성이라는 4가지 EEAT에 근거해 정의되는 고품질 콘텐츠인지 여부로 평가된다는 게 창업 이후 구글의 핵심이라고 밝혔다. 이는 신뢰할 수 있는 정보를 표시하도록 설계된 검색 결과 순위 시스템 등을 통해 계속되고 있다는 것.

더구나 구글은 저품질 콘텐츠는 구글 검색이 해결하는 과제로 새로운 게 아니라며 콘텐츠 유용성을 판단하는 기존 시스템이 있다고 밝혔다. 또 AI를 포함한 자동화로 주로 검색 결과 순위를 조작하기 위해 콘텐츠를 만드는 건 구글 스팸 정책으 위반한다지만 AI를 포함한 자동화가 반드시 스팸 정책을 위반하는 건 아니라고 밝혔다. 자동화는 스포츠 경기 결과, 일기 예보, 문자 발생 등 유용한 콘텐츠를 위해 오랫동안 사용되어 왔으며 Ai를 통해 유용한 콘텐츠를 지원하고 생성할 수 있다고 밝히고 있다.

또 구글은 콘텐츠가 AI에서 생성된 걸 명시할 의무는 없지만 검토해야 하며 웹페이지 제작에 AI를 이용하면 독자에게 이를 명시해야 한다고 밝히고 있다. 관련 내용은 이곳에서 확인할 수 있다.

구글은 지난 2월 8일 대화형 AI 서비스인 바드를 발표하는 동시에 AI 대응 이미지 검색이나 구글맵, 구글 번역 관련 업데이트도 발표했다. 이런 업데이트를 통해 구글 렌즈 확장, 몰입감 있는 구글맵, 컨텍스트 이해가 뛰어난 구글 번역 등을 전개하겠다는 것이다.

먼저 현재 검색바에 촬영한 사진이나 이미지를 입력해 검색을 할 수 있지만 이번 발표에선 구글 렌즈를 이용해 브라우징 중인 사이트나 앱에서 전환하지 않고 표시 중인 이미지나 동영상을 검색할 수 있게 된다고 발표했다. 이 기능은 앞으로 몇 개월 안에 안드로이드용으로 제공된다.

또 이미지나 텍스트를 동시에 검색할 수 있는 멀티서치 기능은 현재 미국이나 영국에서 이용 가능하지만 기능을 한층 더 확대해 AI를 이용해 제공하는 매장만을 좁혀 표시하는 등 위치 정보에 대응한다. 이 기능은 앞으로 몇 개월 안에 전 세계에 배포될 예정이다.

구글맵도 업데이트했다. 이머시브 뷰라고 불리는 기능이 2월 8일부터 런던과 LA, 뉴욕, 샌프란시스코, 도쿄에서 전개된다. 이머시브 뷰는 스트리트뷰와 항공사진 수십억 개를 융합해 도시 디지털 모델을 만든다. 또 날씨와 교통 상황, 혼잡 상황 등을 디지털 모델에 겹칠 수 있다.

이런 디지털 모델을 작성하기 위해 NeRF라고 불리는 고도의 AI 기술을 이용해 통상 이미지를 3D 표현으로 변환하고 있다고 한다. NeRF를 이용하면 조명이나 질감, 배경 등 현실적인 표현이 가능하다.

또 AI와 증강현실을 병행해 카메라 화면에 순서를 오버레이해 건물이나 레스토랑 등에 이끄는 실내 라이브뷰 기능을 1,000개 넘는 공항이나 역 등으로 확대된다고 한다.

이어 구글 번역. 구글 번역도 강화해 영어나 불어 등을 번역할 때 의도에 따라 구문이나 관용구, 적절한 단어를 정확하게 번역할 수 있게 된다. 또 구글 번역 앱 입력 화면이 확대되어 음성에 의한 입력이나 이미지로부터 번역에 대한 액세스가 쉬워진다. 이 기능은 현재 안드로이드에서만 이용할 수 있지만 몇 주 안에 iOS에서도 이용할 수 있다.

또 안드로이드 한정 기능으로 AI에 의한 이미지 번역도 강화한다. 기기 카메라를 이용해 표시되는 텍스트를 번역하고 AR 기능을 통해 원래 이미지에 자연스럽게 표시하는 기능도 지원한다. 관련 내용은 이곳에서 확인할 수 있다.

major update

major update  to your image to find what you're looking for nearby, like a local snack.

to your image to find what you're looking for nearby, like a local snack.