마이크로소프트가 2025년 2월 실제 세계 모습과 디바이스 화면을 인식하고 행동할 수 있는 멀티모달 AI 에이전트 기반 모델인 마그마(Magma)를 발표했다.

마이크로소프트에 따르면 마그마는 멀티모달 세계를 인식하고 목표 기반 행동을 정확히 수행하는 것을 목표로 하며 디지털 세계와 실제 세계를 막론하고 이미지와 영상을 인식하고 관찰에 기반한 행동을 취하기 위해 뛰어난 언어적 지능과 공간적·시간적 지능을 모두 갖추고 있다고 한다. 마그마 개발팀은 디지털 세계와 실제 세계 중 어느 한쪽에 국한되지 않고 인간처럼 양쪽 세계에 걸쳐 작동하도록 하는 게 마그마의 최종 목표라고 밝혔다.

마그마에 입력된 이미지와 영상은 비전 인코더로 토큰화되며 웹페이지나 사진 등에 기재된 텍스트는 직접 토큰화된다. 이후 마그마는 토큰 처리를 수행하고 언어, 공간 및 실제 행동과 같은 출력을 생성한다.

마이크로소프트는 마그마에 대해 사전 학습된 마그마는 도메인별 미세 조정 없이도 작업 수행이 가능하다며 마그마는 멀티모달 이해와 UI 내비게이션과 조작, 로봇 조작 등 모든 작업을 수행할 수 있는 유일한 AI 모델이라고 주장했다.

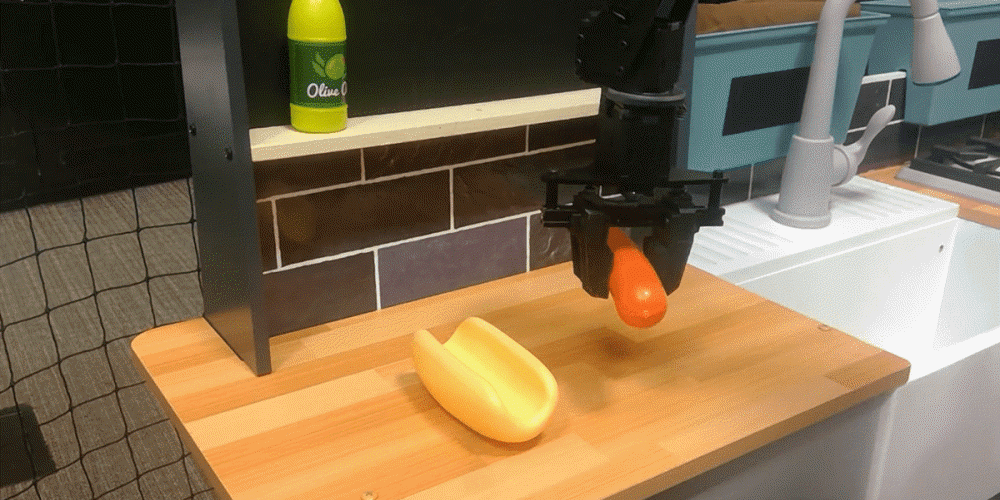

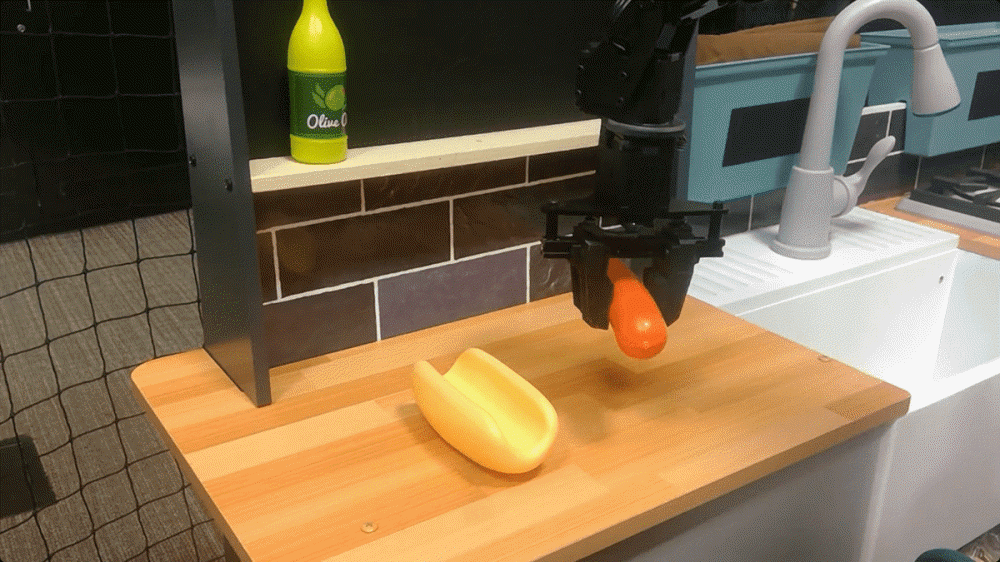

마이크로소프트는 마그마 데모도 공개했다. 실제 세계 영상을 마그마에 입력하고 질문했을 때의 실제 마그마 답변을 볼 수 있다.

멀티모달 AI인 마그마는 사용자 스마트폰 등을 조작하는 것도 가능하다. 시애틀 날씨는 어떠냐고 질문받은 마그마는 크롬을 사용해 검색하는 모습과 비행기 모드를 끄는 모습도 볼 수 있다. 그 밖에도 마그마는 로봇을 조작할 수 있다. 버섯을 집어 볼에 넣으라고 지시받은 마그마는 정확하게 작업을 수행한다.

한편 마그마 모델 데이터와 관련 코드는 곧 공개될 예정이다. 관련 내용은 이곳에서 확인할 수 있다.