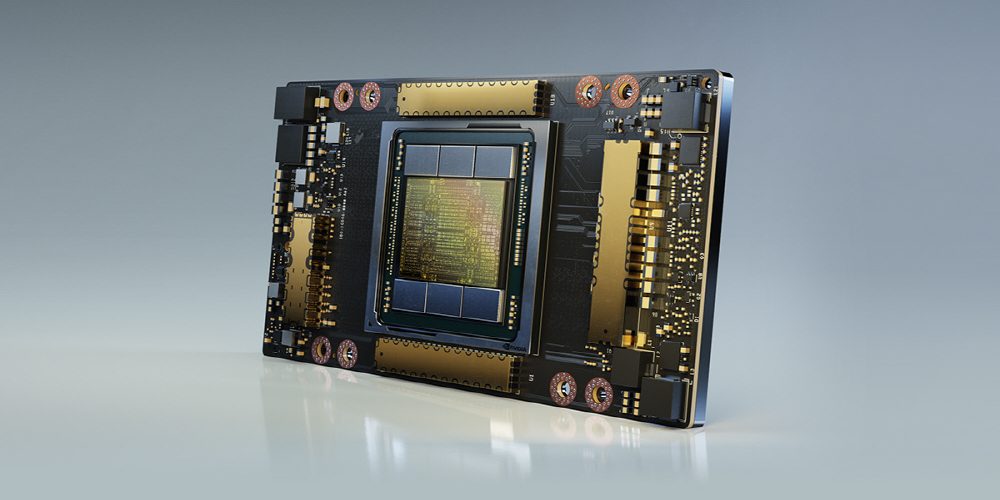

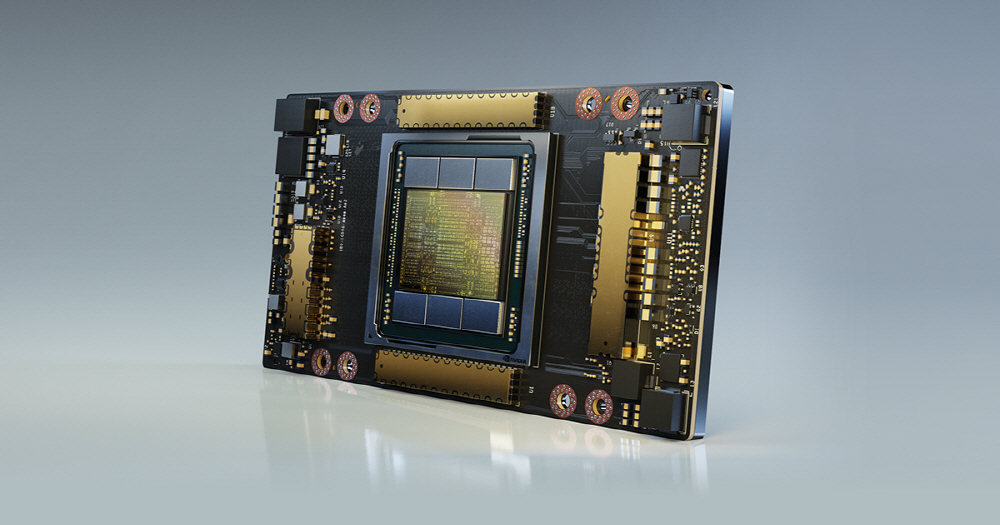

온라인으로 열린 자사 콘퍼런스 GTC2020 기간 중 젠슨황 엔비디아 CEO는 기조연설을 통해 차세대 암페어(Ampere) 아키텍처를 채택한 데이터센터용 GPU인 엔비디아 A100(nVIDIA A100)을 출시했다.

그는 클라우드 컴퓨팅과 AI 트렌트는 데이터센터 설계에 구조적 변화를 주도하고 있다면서 암페어 마이크로 아키텍처를 채택한 엔비디아 A100은 데이터 분석에서 추론까지 이전 모델인 테슬라 V100보다 20배까지 AI 성능을 끌어올릴 엔드투엔드 기계학습 가속기라고 강조했다.

또 A100 GPU로 구현한 3세대 NV링크(NVLink) 상호 연결은 GPU와 스위치당 링크 수가 늘어나기 때문에 3세대 NV링크는 GPU간 통신 대역폭을 대폭 확대하고 신호 쌍방 50Gbps 전송이 가능하며 오류 감지와 복구 기능이 향상됐다고 한다.

엔비디아 A100의 사양을 보면 TSMC 7nm 제조공정을 이용하며 다이 크기는 826mm2이며 트랜지스터 수는 542억개로 기존 테슬라 V100보다 거의 2배에 이른다. GPU 메모리는 40GB이며 메모리 대역폭은 1.555TB/sec, 열 설계 전력은 최대 400W다.

A100 GPU의 가장 큰 특징은 멀티 인스턴스 GPU MIG(Multi-Instance GPU) 기능, 그러니까 GPU 파티셔닝 기능이 포함되어 있다는 것. GPU 자원을 분할하고 다른 인스턴스로 병렬 처리할 수 있게 해준다. 칩 하나로 7인스턴스까지 처리할 수 있다.

또 암페어 아키텍처와 A100 GPU를 발표하는 동시에 엔비디아의 병렬 컴퓨팅 플랫폼인 쿠다(CUDA) 11도 발표했다. 쿠다11은 고성능 계산과 유전자 분석, 5G 통신 무비 렌더링, 딥러닝 데이터 분석 등 다양한 워크로드를 가속화해준다. 엔비디아는 그 뿐 아니라 3세대 통합 AI 시스템으로 GPU에 A100 8개, CPU에 AMD 에픽 로마(EPYC Roma) 2개, 스토리지는 SSD 15TB, 스위치 칩에 NV스위치(NVSwitch) 6개, 네트워크 인터페이스에 멜라녹스의 커넥트엑스-6 200Gbps(ConnectX -6 200Gbps) 9개를 탑재한 유닛 DGX A100도 발표했다. 엔비디아에 따르면 DGX A100은 1개 단위에서 5페타플롭스 연산 능력을 보여주며 가격은 19만 9,000달러가 될 것이라고 한다.

엔비디아에 따르면 A100 GPU는 이미 다양한 기업과 연구소에서 사용되고 있다. 마이크로소프트는 암페어 아키텍처 기반 GPU를 이용해 170억 파라미터를 가진 세계 최대 언어 모델인 튜링 NLG(Turing NLG)를 학습시켰다. 한편 젠슨황이 기조연설을 한 영상 속 장소는 캘리포니아에 있는 그의 집 부엌이라고 한다. 관련 내용은 이곳에서 확인할 수 있다.