GPT-4, LLaMA, 클로드 같은 대규모 언어 모델은 2017년 구글 연구원이 발표한 트랜스포머(Transformer)라는 프레임워크를 기반으로 구축됐다. 이 트랜스포머 기반 AI 모델이 어떻게 작동하는지를 시각화한 도구인 트랜스포머 익스플레이너(Transformer Explainer)가 조지아 공대 연구팀(Polo Club of Data Science)에 의해 공개됐다.

트랜스포머 익스플레이너에 들어가면 오른쪽 상단에 있는 버튼(Temperature)은 다음 단어를 예측할 때 확률 분포에 영향을 미치는 변수다. 슬라이드 바를 좌우로 움직이면 확률 분포가 변동하고 그에 따라 다음에 출력될 단어도 달라진다.

상단에 있는 입력란에 직접 문장을 입력할 수도 있다. 입력란 오른쪽에 있는 버튼(Generate)을 클릭하면 설정된 템퍼러처에 따라 확률 분포가 계산되고 다음 단어가 출력된다.

이 확률 분포가 어떻게 생성되는지 알고 싶다면 왼쪽 항목(Embedding)에서 확인할 수 있다. 이 임베딩에서는 입력된 문자열을 토큰이라는 단위로 분해한 뒤 벡터로 변환한다. 트랜스포머 익스플레너 내 임베딩 부분을 클릭하면 토큰이 변환되는 과정이 시각화된다.

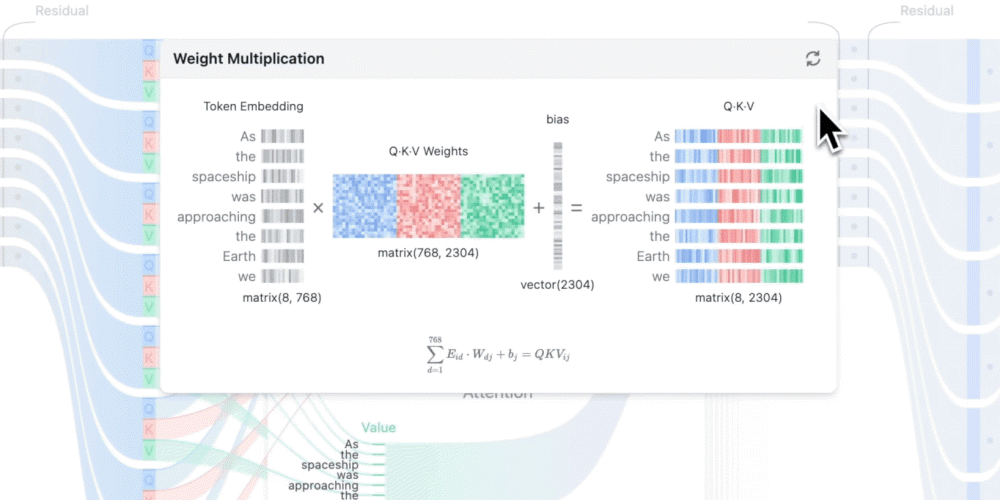

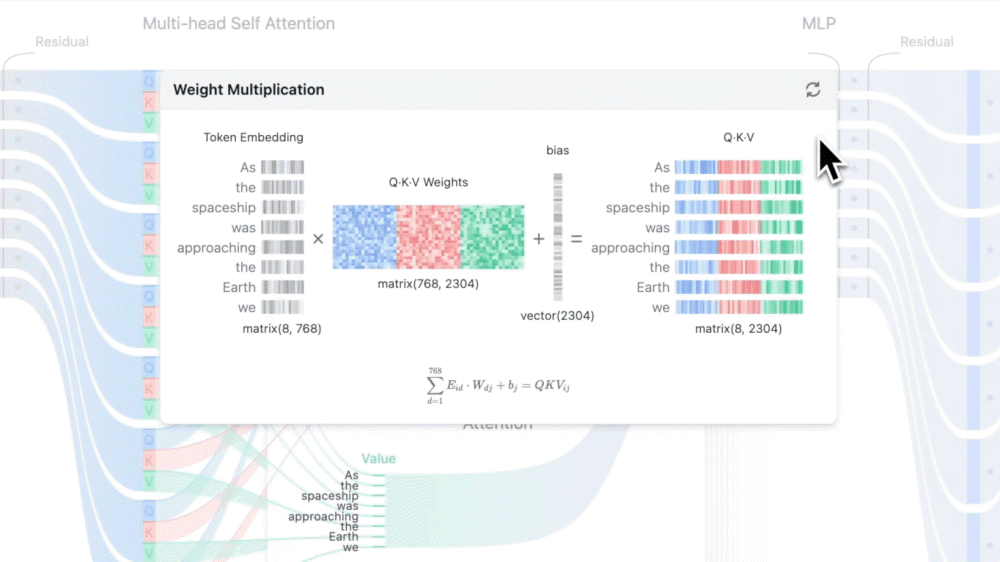

그 후 이 벡터에서 3가지 입력(Query, Key, Value)을 계산한다. 이 계산 과정은 토큰에서 뻗어 나가는 파란색 선을 클릭하면 표시된다. 트랜스포머 핵심은 데이터에서 예측에 유용한 요소를 가중치를 부여해 주목하는 메커니즘(Attention)이다. 중앙 부분(Multi-Head Attention)을 보면 쿼리와 키 내적을 소프트맥스(Softmax)라는 함수로 정규화해 가중치를 계산하고 이 가중치를 밸류와 곱해 출력 결과를 생성하는 과정을 확인할 수 있다.

트랜스포머 익스플레너는 오픈 소스로 개발됐으며 MIT 라이선스에 따라 소스 코드가 깃허브에서 공개됐다. 관련 내용은 이곳에서 확인할 수 있다.