애플은 2021년 8월 아이폰 내 사진과 메시지를 스캔해 아동학대성 콘텐츠 CSAM을 삭제하는 기능 구현 예정을 발표했지만 아이폰 내 정보 스캔은 사용자 프라이버시를 훼손한다며 비난받으며 2022년 12월에는 해당 기능 구현을 단념했다는 보도가 나왔다. 새롭게 애플이 아동보호단체 질문에 응하는 형태로 데이터 스캔 기능 구현 포기 이유를 밝혔다.

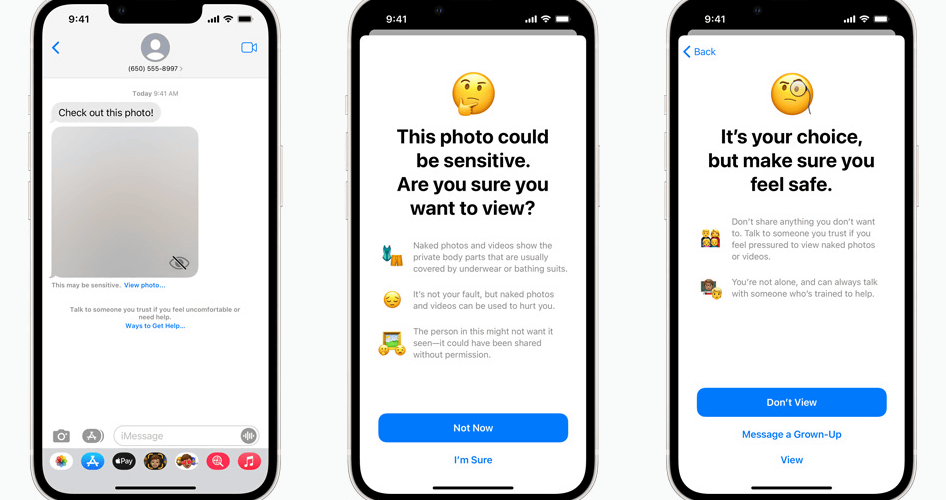

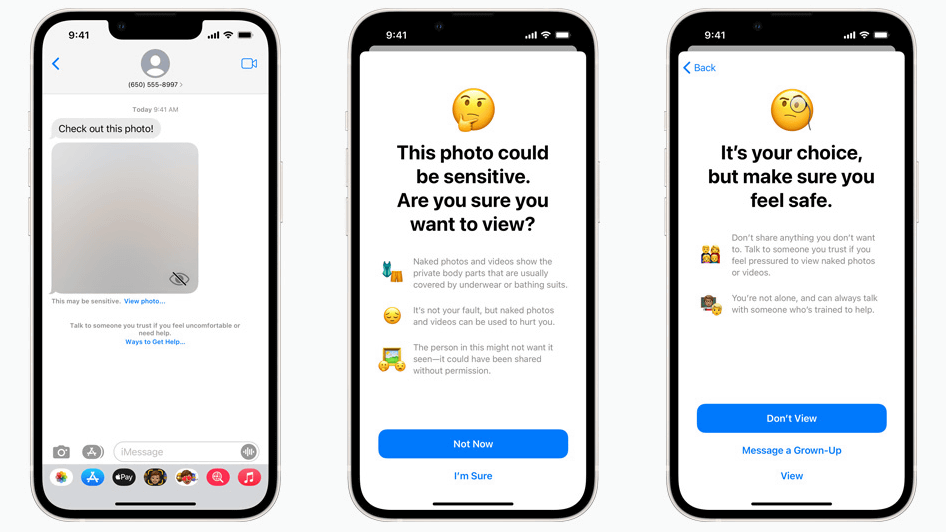

애플에 CSAM을 흐리게 하는 기능이나 CSAM을 보내려고 하면 경고하는 기능을 포함하거나 아이클라우드에 저장한 사진이 CSAM인지를 재도하거나 시리에서 CSAM을 검색하면 경고하는 기능을 도입하는 걸 목표로 하고 있었다.

애플은 CSAM 검출 도구를 2021년 말까지 구현 예정으로 하고 있었지만 발표 직후부터 전자프런티어재단 등으로부터 사용자 프라이버시를 손상시킨다는 항의가 모이면서 2021년 9월 구현 시기 연기를 발표했다.

또 애플은 2022년 12월 2021년에 제안한 아동 보호에 관한 대처에 대해 전문강롸 폭넓게 협의해 피드백을 모은 결과 2021년 12월 처음으로 제공한 커뮤니케이션, 안전 기능에 대한 투자를 심화시킬 예정이며 이전에 제안한 아이클라우드 포토 내 CSAM 감지 도구 개발을 진행하지 않기로 결정했다. 하지만 2022년 12월 애플은 CSAM 감지 도구 구현을 포기한 이유를 밝히지 않았다.

새롭게 애플은 아동보호단체(The Heat Initiative) 질문에 답하는 형태로 CSAM 검출 도구 구현을 포기한 이유를 밝혔다. 애플 답변에 따르면 CSAM 검출 도구에 필요한 아이클라우드상 데이터를 스캔하는 기능을 구현하면 공격자에게 악용될 가능성이 생긴다고 한다. 또 CSAM 스캔을 시작하면 스캔 대상이 점차 확산되고 암호화된 메시지의 광범위한 스캔이 실시될 수 있다는 우려도 CSAM 검출 도구 구현 단념으로 이어졌다고 한다.

덧붙여 애플은 2021년 시점에서 CSAM 스캔을 위해 암호화된 메시지 스캔 등도 시야에 넣고 있었지만 현재 암호화된 메시지 보호에 힘을 쏟고 있다. 예를 들어 영국에서 내무부에게 기업에 E2E 암호화 기능을 취소시키는 권한을 준다는 법안이 제안됐을 때에는 법안은 보안 보호를 위해 거부되어야 한다는 성명을 발표하기도 했다. 관련 내용은 이곳에서 확인할 수 있다.