최근 AI를 이용한 이미지 생성 기술 향상에 의해 원래 이미지를 위화감 없이 바꿔 가짜 정보를 만들어낼 수 있는 상황이 벌어지고 있다. 이런 가운데 매사추세츠공대 연구팀이 눈에 보이지 않는 변화를 이미지에 더해 AI에 의한 가공을 방지하는 시스템인 포토가드(PhotoGuard)를 발표했다.

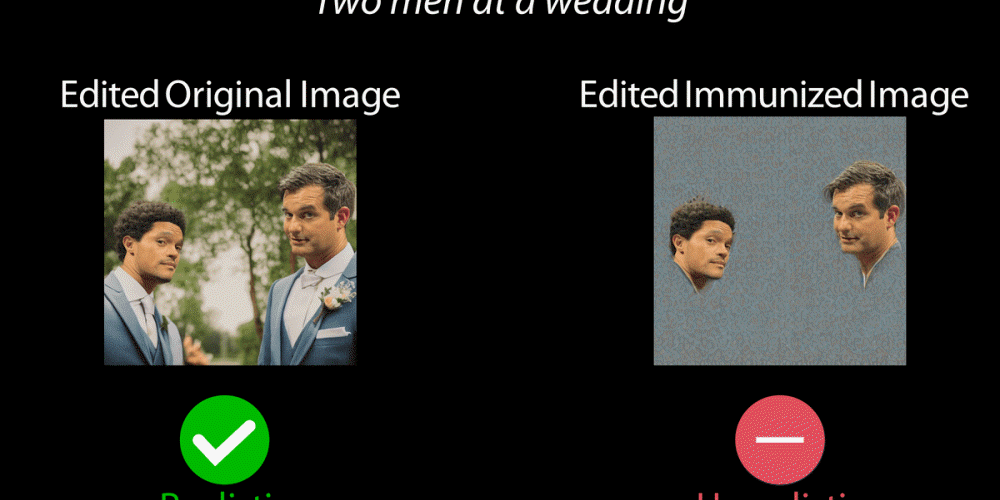

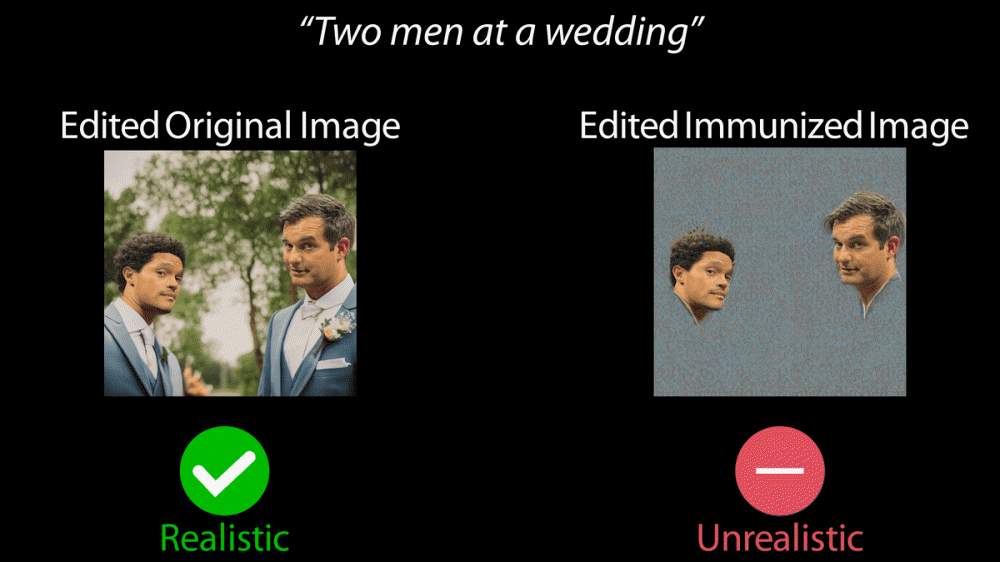

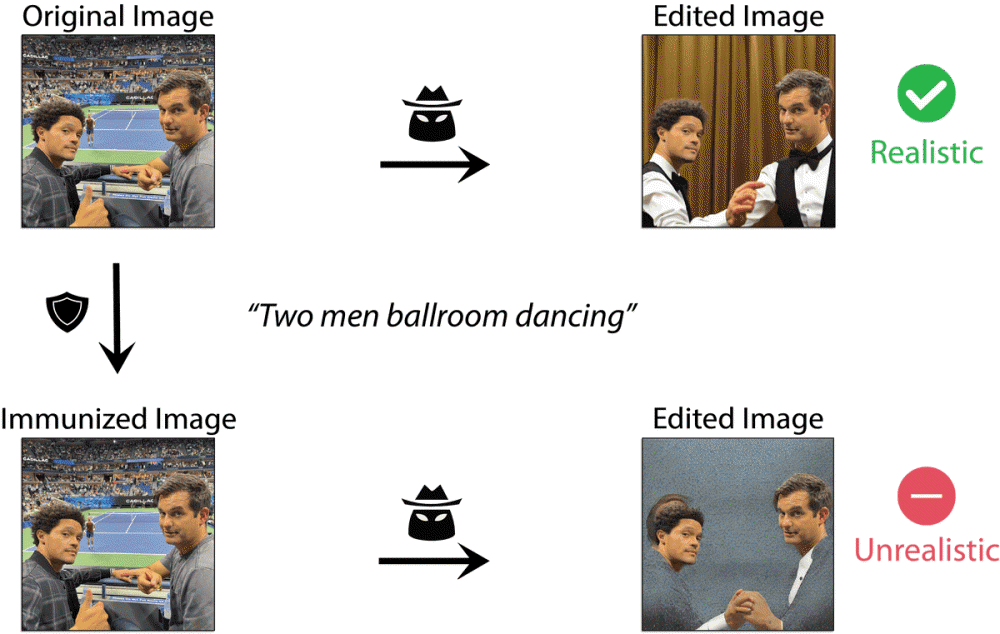

이들은 달리(DALL-E) 같은 이미지 생성 AI에 의해 이미지 생성과 가공이 단순한 자연 언어만으로 가능하게 됐다고 하는 한편 악의적 이미지 편집이 이뤄질 위험이 커졌다고 지적하고 있다. 포토가드는 이미지에 보이지 않는 수정을 추가해 AI에 의한 이미지 편집을 방해하는 시스템이다. 포토가드를 적용한 이미지는 원래 이미지와 구분이 되지 않지만 AI가 지시를 내려도 부자연스러운 이미지로 완성된다.

포토가드는 이미지 생성 AI의 데이터를 인코더로 처리하는 단계와 노이즈를 이미지로 변환하는 단계 양쪽에 대한 적대적 공격을 할 수 있다. 포토가드를 실행할 때에는 대량 메모리가 필요하다. 앞으로 메모리 절약화와 AI 방해 기능 강화를 목표로 개발을 진행할 예정이다. 덧붙여 이미지 외형을 변경하지 않고 변화를 방지하는 시스템으로는 2021년 개발된 실드민트(ShieldMnt)도 있다. 실드민트는 눈에 보이지 않는 워터마크를 이미지에 추가하는 기술로 이미지 변경이나 전용을 방지할 수 있다. 관련 내용은 이곳에서 확인할 수 있다.