소셜 네트워크 분석 기업인 그래피카(Graphika)에 따르면 AI를 사용해 여성 사진에서 누드 이미지를 생성하는 서비스가 증가하고 있으며 2023년 9월에만 2,400만 명이 액세스하고 있다고 보고했다.

이에 따르면 AI에 의해 임의 사진에 찍혀 있는 인물을 마음대로 누드화하는 NCII(non-consensual intimate imagery) 생성 서비스는 소셜미디어로 홍보되고 있어 AI에 의한 NCII 생성 서비스 홍보 스팸량은 2023년 초부터 레딧이나 엑스 등에서 2000% 이상 증가하고 있다고 한다.

또 그래피카가 특정한 NCII 생성 서비스 34건 사용자는 2023년 9월 시점 2,400만 명에 이른다고 한다. 또 서비스에 액세스하기 위해 암호화 메시징 앱인 텔레그램을 사용하며 사용자 최소 100만 명이 확인됐다.

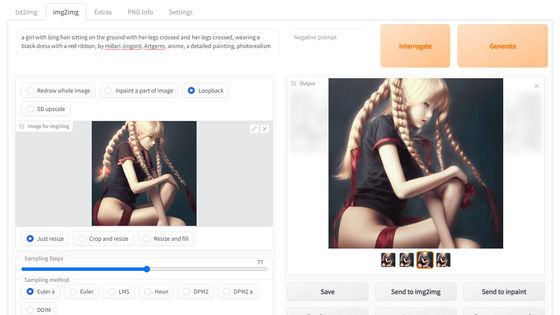

그래피카는 이런 NCII 생성 서비스는 오픈소스에서 개발된 이미지 생성 AI 기능과 접근성 향사에 의해 지원되고 있다고 평가하고 있으며 많은 공급자가 사진처럼 리얼한 누드 이미지를 대규모 또는 간단하고 저렴하게 만들 수 있게 되어 점점 확대되고 있다고 지적하고 있다.

NCII 생성 서비스에 사용되는 원래 이미지는 소셜미디어로부터 취득된 게 많아 대상자 동의 없이 마음대로 생성, 배포되는 게 대부분이며 법적, 윤리적으로도 큰 문제를 야기한다. 그 중에서도 엑스에 게시된 NCII 생성 앱을 홍보하는 이미지에는 고객이 누드 이미지를 만들고 이 이미지를 누드화된 사람에게 보낼 수 있다는 걸 시사하는 문언이 사용되고 있는 등 괴롭힘을 선동한다고 할 수 있다. 이런 앱 중 일부는 구글이나 유튜브에 광고비를 지불하는 경우도 있다는 지적이다.

구글 측은 자사는 성적으로 노골적인 콘텐츠가 포함된 광고를 허용하지 않는다며 문제가 된 광고를 검토하고 정책 위반 광고를 삭제했다고 밝혔다. 레딧 측은 자사에선 성적 자료를 비동의로 공유하는 걸 금지하고 있으며 조사 결과 일부 도메인을 금지했다고 보고했다.

관련 기관은 많은 NCII 생성 서비스 피해자는 자신의 누드 이미지를 생성한다는 걸 알지 못한다며 집행기관에 수사를 요청하거나 법적 조치를 추구하는 건 어려울 수 있다고 밝혔다. 관련 내용은 이곳에서 확인할 수 있다.