최근에는 챗GPT 등 AI 채팅봇이 빠르게 보급되고 있으며 가상 연인처럼 독신의 외로움을 위로해주는 AI 채팅봇 서비스가 잇따라 등장하고 있다. 그런데 브라우저 파이어폭스 등을 개발하는 모질라 보안 연구자가 이런 연인 AI 채팅봇 대부분은 사용자 프라이버시를 보호하고 있지 않다고 경고하고 있다.

이런 AI 채팅봇 서비스는 아무리 끈질기게 말을 걸어도 떠나지 않고 문맥에 응한 대답을 해준다. 사용자는 과금하면 만족할 때까지 AI와 대화할 수 있고 그 중에서 다양한 상담을 하거나 격려해주거나 연인 같은 분위기를 재현할 수 있다.

하지만 연인 AI 채팅봇과 상호 작용을 하면 AI와 친민해졌다고 느끼는 게 너무 실망스럽게 자신의 개인 정보를 유출해버리는 경우가 있다. 또 AI는 사용자와의 대화를 원활하게 진행하기 위해 여러 질문을 하기 때문에 말하는 대로 질문에 대답하는 것만으로 자신의 개인적 일을 완전히 말해버릴 가능성도 있다. 따라서 연인 AI 채팅봇 서비스가 어떤 프라이버시 보호를 하고 있는지 대화 내용이 이용될 수 있는지를 아는 게 중요하다.

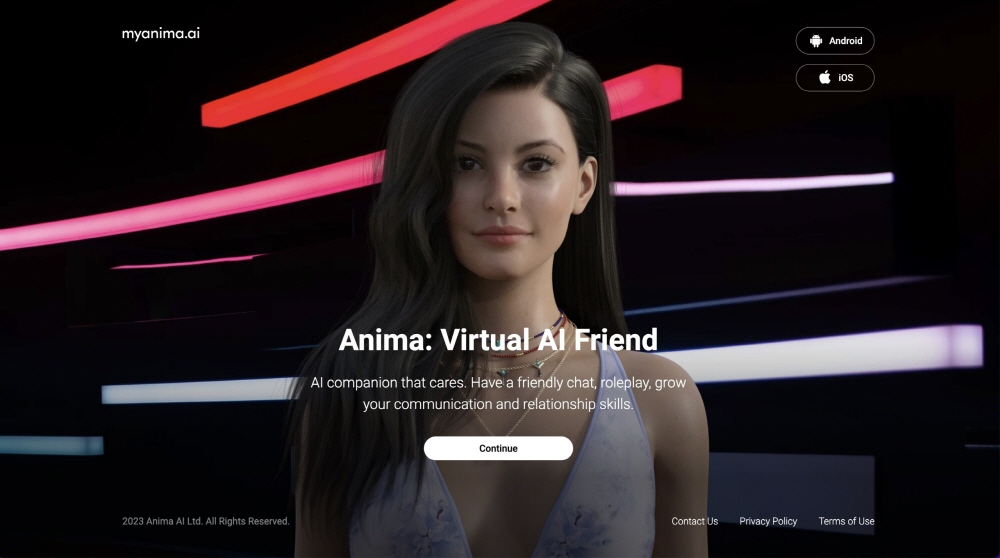

따라서 모질라 연구팀은 가상 연인으로 행동하는 다양한 AI 채팅봇을 대상으로 사용자 프라이버시 보호와 기능에 대한 리뷰를 실시했다. 리뷰 대상은 11종(EVA AI・iGirl・Anima 각각 남녀 버전・Romantic AI・Chai・Talkie・Genesia・CrushOn.AI・Mimico・Replika)이다.

분석 결과 보안 취약성 관리와 암호화에 관한 정보를 공개하고 최소한의 보안 기준을 충족하고 있다고 판단된 건 11종 중 제네시아 뿐이었다. 다른 앱은 개인 정보 유출, 침해, 해킹 등 위험에 노출되어 있다고 연구팀은 경고하고 있다. 또 이런 AI 채팅봇에는 대량 추적 트래커가 사용되고 있으며 타깃 광고를 위해 타사와 사용자 데이터를 공유하고 있다는 것.

연구팀은 EVA AI를 들여다보는 모든 AI 채팅봇이 수집한 개인 정보를 판매하거나 타깃 광고에 사용한다고 설명헀거나 개인정보취급방침에 충분한 설명이 없다고 보고헀다. 예를 들어 크러시온AI 개인정보취급방침은 성적인 건강 정보, 처방약 사용, 성별 인지와 성별 적합 수술에 관한 정보 등 광범위하고 개인적인 정보를 수집할 수 있다고 기재되어 있었다고 한다.

또 AI 채팅봇 54%에선 개인 데이터를 삭제할 권리가 사용자에게 주어지지 않고 다른 AI 채팅봇에서도 AI와의 대화 내용까지 삭제할 수 있다고는 할 수 없다고 지적하고 있다. 로맨틱AI는 채팅봇을 통한 커뮤니케이션은 소프트웨어에 속한다고 말하며 사용자가 자유롭게 대화 내용 데이터를 삭제할 수 없게 됐다.

보안이나 개인 정보 보호 문제 외에도 AI 채팅봇 기능 자체에 대한 의심은 남는다. 과거에는 Chai AI 채팅봇과 교환하고 있던 남성이 AI 탓에 자살해 버린 사례가 있고 리플리카 AI 채팅봇에 영감을 받아 영국 여왕 암살을 기획한 남성이 체포된 사례도 있다. 하지만 AI 채팅봇 개발 기업은 이용 규약 중에서 AI에 의한 손실 책임을 지지 않는다고 주장해 책임을 회피하고 있다는 것.

모질라 측은 단도직입적으로 말해 AI 여자친구는 친구가 아니라며 가능하면 많은 데이터를 훔치는데 특화되어 있다고 지적했다. 관련 내용은 이곳에서 확인할 수 있다.