구글이 지난 6월 17일(현지시간) 진행된 음성 기술 온라인 콘퍼런스(Voice Global)에서 구글 어시스턴트(Google Assistant) 핵심 플랫폼과 개발 도구를 개선했다고 밝혔다.

구글 어시스턴트는 30개 이상 언어를 지원하며 매달 5억명 이상이 이용하는 AI 도우미다. 구글은 구글 어시스턴트 성공에 대해 성장 중심에 있는 사람이 자연스러운 방법으로 필요한 걸 손에 넣고 싶다고 원한다는 간단한 통찰력 때문이라고 설명한다. 목소리라는 사람에게 자연스러운 방법으로 기술을 활용할 수 있게 엄청난 투자를 해오고 있다는 것이다.

구글은 핵심 플랫폼과 개발 도구 개선을 밝힌 것도 이런 노력의 일환이다. 지금까지 구글 보조 액션을 만들려면 개발자 플랫폼인 액션 콘솔과 자연어 처리를 위한 개발자 도구인 다이얼로그플로(Dialogflow)를 모두 이용해야 했다.

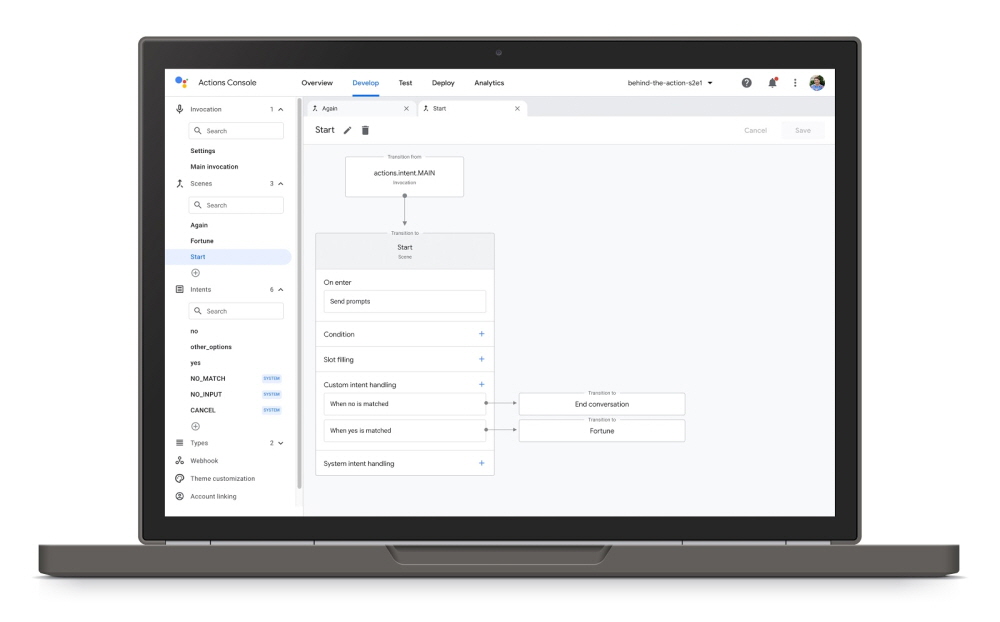

하지만 구글은 통합 플랫폼 하나만 있으면 좋겠다는 아이디어를 바탕으로 대화 흐름 전체를 그래픽 인터페이스로 볼 수 있는 웹 기반 통합 개발 환경인 액션빌더(Actions Builder)를 출시했다. 액션빌더는 자연어 이해 NLU(Natural language understanding) 훈련 데이터를 관리하고 고급 디버깅 도구를 제공해 작업 빌드 디버그 테스트 자료 분석을 모두 수행할 수 있다.

구글은 또 자신의 개발 환경에서 작업하려는 수요에도 부응해 액션을 파일 기반으로 보거나 로컬 환경에서 사용할 수 있는 액션SDK(Actions SDK)도 출시했다. 액션SDK는 NLU와 대화 스키마 로컬 제작을 가능하게 할 뿐 아니라 학습 데이터를 한 번에 가져오기, 내보내기를 통해 대화 품질을 향상시킬 수 있게 해준다. 명령 줄 인터페이스도 포함해 좋아하는 소스 관리 도구와 지속적인 통합 도구 작업을 구축, 관리할 수 있다.

액션빌더와 액션SDK 외에도 새로운 대화 모델과 런타임 엔진 개선도 발표했다. 구글에 따르면 이를 통해 대화 모델 설계와 구축이 간소화되어 사용자는 더 빠르고 정확한 응답을 얻을 수 있게 된다고 밝혔다.

구글은 또 스마트 스피커와 스마트 디스플레이에 대해 흥미로운 것 중 하나는 이들이 연계 가능하다는 점이라고 밝혔다. 이를 위해 연결 장치끼리 공동 스토리지 기능을 활용하는 홈 스토리지를 발표했다. 홈 스토리지 활용 방법은 예를 들면 퍼즐 게임 기록을 홈 스토리지에 따로 저장해 게이머마다 진행 상황을 개별 기록하는 것 등을 들 수 있다. 또 미디어(Media) API를 업데이트해 미디어 세션 지원 외에 동영상 이력도 가능해졌다. 사용자는 특정 순간에 동영상 재생을 시작하고 이전 세션을 중단했던 곳에서 영상을 재생할 수 있게 된 것이다.

구글은 앞으로 몇 개월 안에 구글 어시스턴트 업데이트를 다수 발표할 예정이다. 사용자가 직접 설정한 사전 정의 단어나 문구를 등록하는 기능이나 사용자 말에 구글 어시스턴트가 곧바로 응답하는 등 더 유동적인 환경을 제공하게 될 것이라는 설명이다. 관련 내용은 이곳에서 확인할 수 있다.