코넬대학 연구팀이 착용자 표정을 인식해 컴퓨터 화면에 표현하는 기능을 갖춘 헤드폰인 씨-페이스(C-Face)를 개발했다.

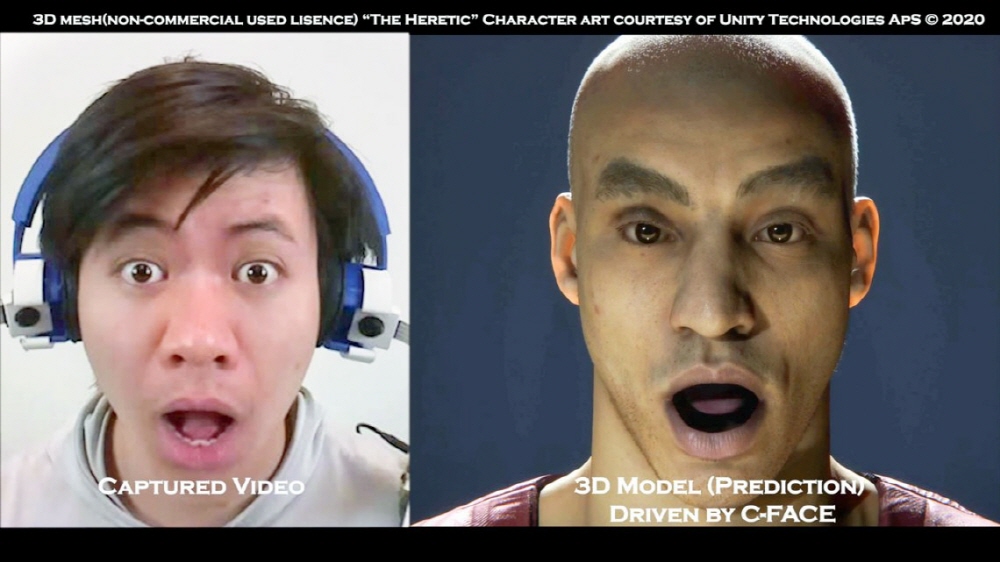

이 헤드폰을 이용하면 자신의 얼굴 표정을 미리 선택해둔 다른 사람 얼굴로 대체, 실시간으로 표시할 수 있다. 웹카메라를 사용하지 않고 영상 통화도 가능하다. 또 가상현실 공간을 사용하는 소셜미디어 등은 아바타 표정을 사용자 표정으로 대체해 더 현실에 가까운 커뮤니케이션을 가능하게 한다.

코넬대학 연구팀은 이 장치가 기존 헤드셋 얼굴 인식 장치보다 간단하고 눈에 띄지 않고 더 높은 표정을 추적하는 능력을 갖고 있다고 설명한다. 예를 들어 코로나19 중 마스크를 착용할 경우 카메라 이미지로 얼굴 인식은 표정을 전할 수 있다. 씨-페이스는 헤드폰 좌우 유닛에 장착한 카메라로 착용자 뺨 근육 움직임을 감지해 얼굴을 자동 생성한다.

이 기술은 딥러닝과 신경망을 활용해 카메라 영상에서 수집한 정보를 모든 표정을 만들어내는 얼굴에 42개 포인트 움직임으로 변환한다. 실험에서 얻어진 결과는 착용자 표정을 85% 이상 정확도로 재현한 것이다. 문제는 카메라를 구동하는 배터리 용량이 제한된다는 것. 연구팀은 더 효율적인 배터리를 적용하는 걸 고려하고 있다.

줌과 페이스타임 등 화상 통화를 할 때 스피커에서 상대방 음성이 나오면 마이크 주위에 에코가 발생할 수 있기 때문에 스피커보다 이어폰이나 헤드폰을 사용해야 더 편안하게 대화할 수 있다. 또 자신의 얼굴과 표정을 카메라를 사용하지 않고 컴퓨터로 생성해 상대방과 대화할 수 있다면 예를 들어 여성이라면 메이크업 수고를 덜 수 있고 실내 모습을 상대방에게 알리지 않는 장점도 있다. 영상 통화와 회의가 앞으로 인기를 끈다면 씨-페이스 같은 기술도 더 보급될지 모른다. 관련 내용은 이곳에서 확인할 수 있다.